mola

“见微知著”

OpenAI 在 o3 和 o4-mini 模型中引入了图像推理能力,模型可以在推理过程中主动对图像进行裁切、放大和旋转,而不只是被动看图像。这种能力让视觉分析从简单的图像识别升级为真正的视觉推理。受此启发,我为 MolaGPT 实现了和 ChatGPT 类似的视觉推理能力。

坐标网格化

LLM 衍生物的 VL 模型在分析复杂图像时存在一个根本问题,当用户询问“这个区域在哪里”时,模型不能更好地定位目标,通常是直接估算像素坐标,而这种估算往往不准确。模型可能会给出超出图片边界的坐标,或者定位到完全错误的位置。

为了改善这一问题,我在图像上叠加了一套标准化的网格坐标系统。根据图像尺寸,系统会自动生成适当密度的网格,然后每个单元格都有明确的坐标标签,如 (A, 1)、(B, 2) 等。视觉模型不再需要猜测像素值,而是识别目标所在的网格单元格。这就将坐标估算转化为了单元格分类任务。

当模型返回"目标位于 (A, 4) 到(B, 4) 区域"时,系统会自动将网格坐标转换为精确的像素坐标,完成后续的裁剪或放大操作。

迭代分析

对于信息密集的复杂图像,单次分析通常无法获取足够的细节,所以 MolaGPT 支持迭代式的分析流程,这些过程可以完全发生在模型的思维链中。

- 全景扫描。 首次分析时,模型会对整张图像进行概览,识别主要区域和值得关注的重点。分析结果会以网格坐标的形式标注建议查看的区域;

- 精准裁剪。 用户可以根据建议,使用自然语言指令让系统裁剪特定区域。如用户希望系统性分析,系统也能分块,或者分重点区域按顺序查看;

- 细节分析。 对裁剪后的图像进行更详细的分析,识别文字内容、图形特征、布局结构等。如果仍有看不清的部分,可以继续迭代放大;

- 结果汇总。 将多轮分析的信息整合,形成完整的图像理解。

系统支持使用自然语言描述目标区域,例如:“查看一下这个截图”

在整个过程中,用户和主要模型都不需要手动计算裁剪坐标,后端的多 Agent 会自动完成自然语言到区块再到坐标的转换,系统会自动完成以下流程:在图像上叠加网格 → 让视觉模型识别目标描述对应的网格单元格 → 将网格坐标转换为像素坐标 → 执行裁剪或放大操作。

实际案例

视觉推理允许用户以更符合直觉的方式与 MolaGPT 交互。用户可以通过拍照来提问,而不必担心对象的位置,甚至即使乍看之下对象并不明显,视觉推理也能促使模型将照片放大,从而看得更清楚。下面是几个实际的例子来说明视觉推理对问题解决的促进作用。

所有案例均由 MolaGPT 上的 DeepSeek V3.2 (Thinking) 模型完成

案例 1

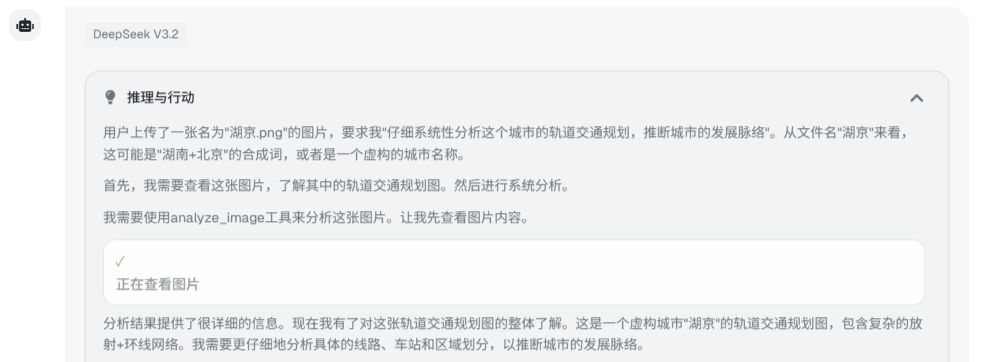

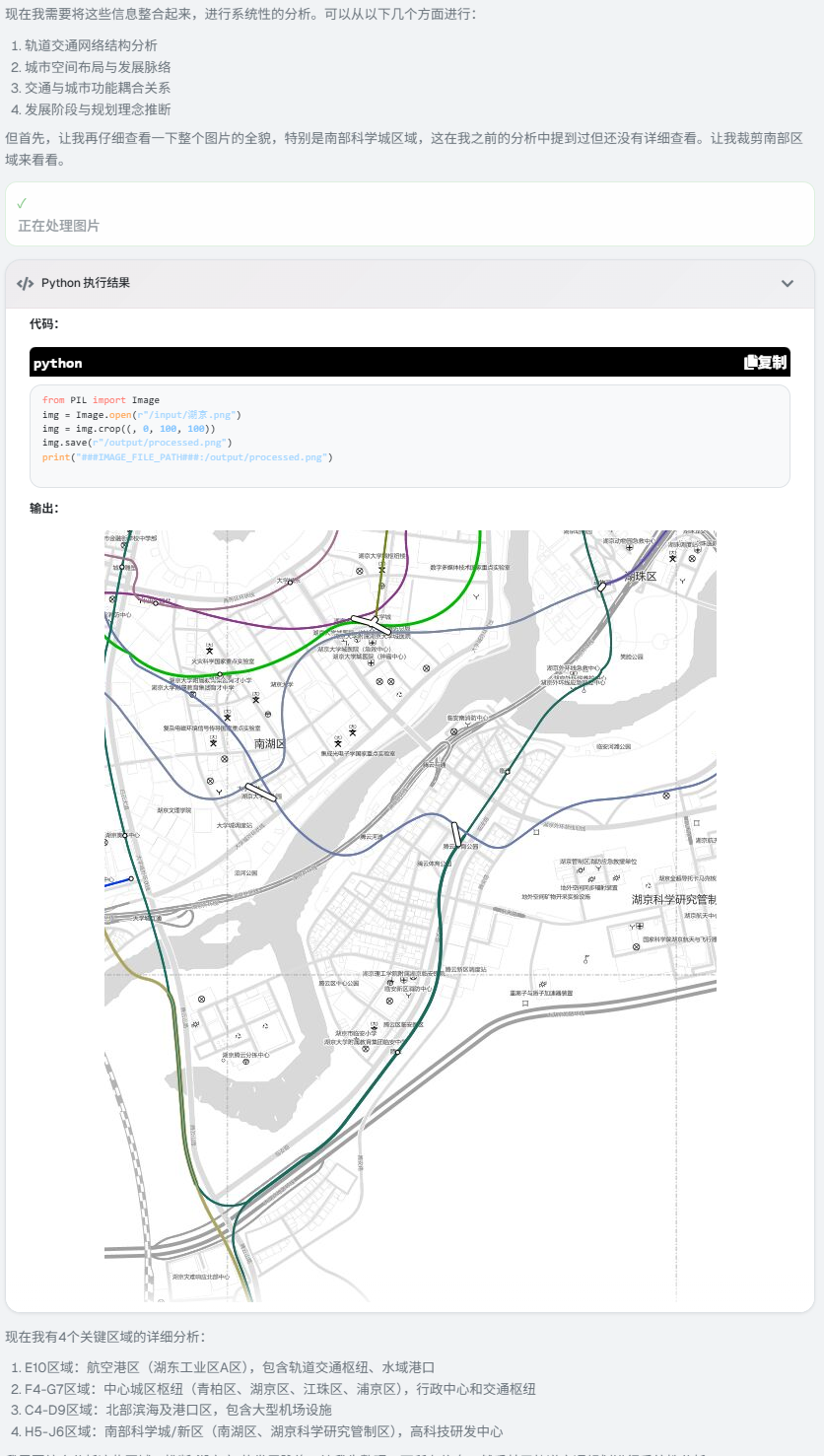

我以我在游戏《都市:天际线》的 CSLMapview Mod 生成的路网与轨道交通图像作为附件,然后提出问题:“仔细系统性分析这个城市的轨道交通规划,推断城市的发展脉络。”

模型在大致查看图片后,得出结论:

“现在我有了对这张轨道交通规划图的整体了解。这是一个虚构城市‘湖京’的轨道交通规划图,包含复杂的放射+环线网络。我需要更仔细地分析具体的线路、车站和区域划分,以推断城市的发展脉络。让我进一步放大查看关键区域,获取更多细节。我将使用image_file_process工具来裁剪和放大中心城区等重要区域。”

随后,模型对轨道交通线路密度较高的中心城区进行了放大处理,随后得出结论:

“从截取的中心城区枢纽区域(F4-G7)分析中,我看到了更详细的区域划分:青柏区、湖京区、江珠区、南湖区。有大量机构标注:学校、政府机构、医院、公园等。”

“有多条轨道交通线路,包括环线系统和放射线。线路在中心城区高度密集,形成多个多线换乘枢纽。”

随后,模型又查看了南部科学城、滨海区及航空港区的轨道交通情况并给出了最终的分析结果。

“湖京市轨道交通网络展现出典型的 "放射状+环线+网格" 复合结构:

放射状骨干线:至少6条骨干线路从中心城区向外辐射,连接各功能区

环线系统:在中心城区(F4-G7区域)形成了清晰的环状线路,优化换乘效率

网络加密:各功能区内部存在次级支线,形成分层级服务网络

线路密度分级:中心城区 > 新区科学城 > 滨海港区 > 远郊区域

换乘枢纽布局:在F5-G6区域形成超大型综合交通枢纽,连接5条以上

线路走向:主要沿城市发展轴布设,与主要交通走廊高度重合

区域快线(深绿色线):连接港口、机场等交通门户

市区干线(红色/蓝色线):连接中心城区与主要副中心

加密支线(黄色/紫色线):服务功能区内部通勤”分析来自 MolaGPT

案例 2

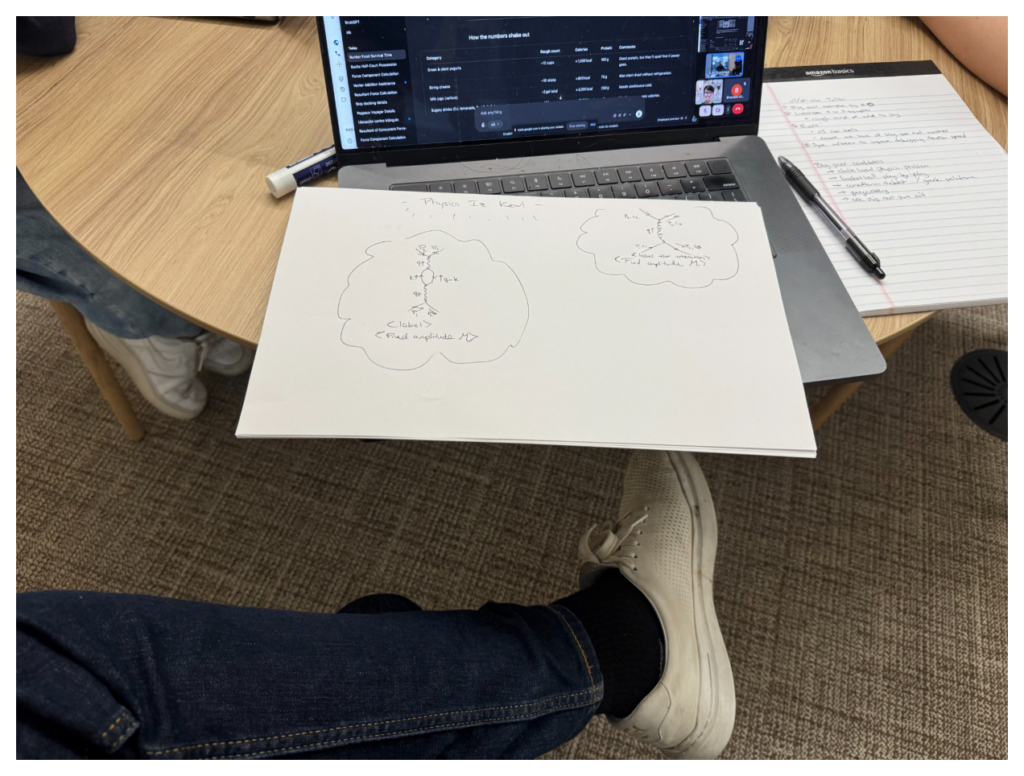

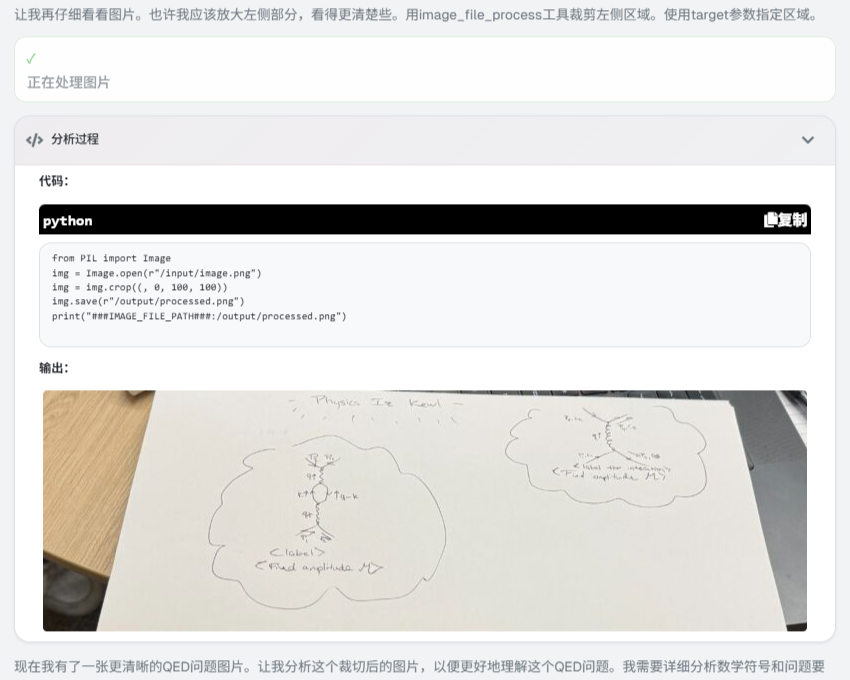

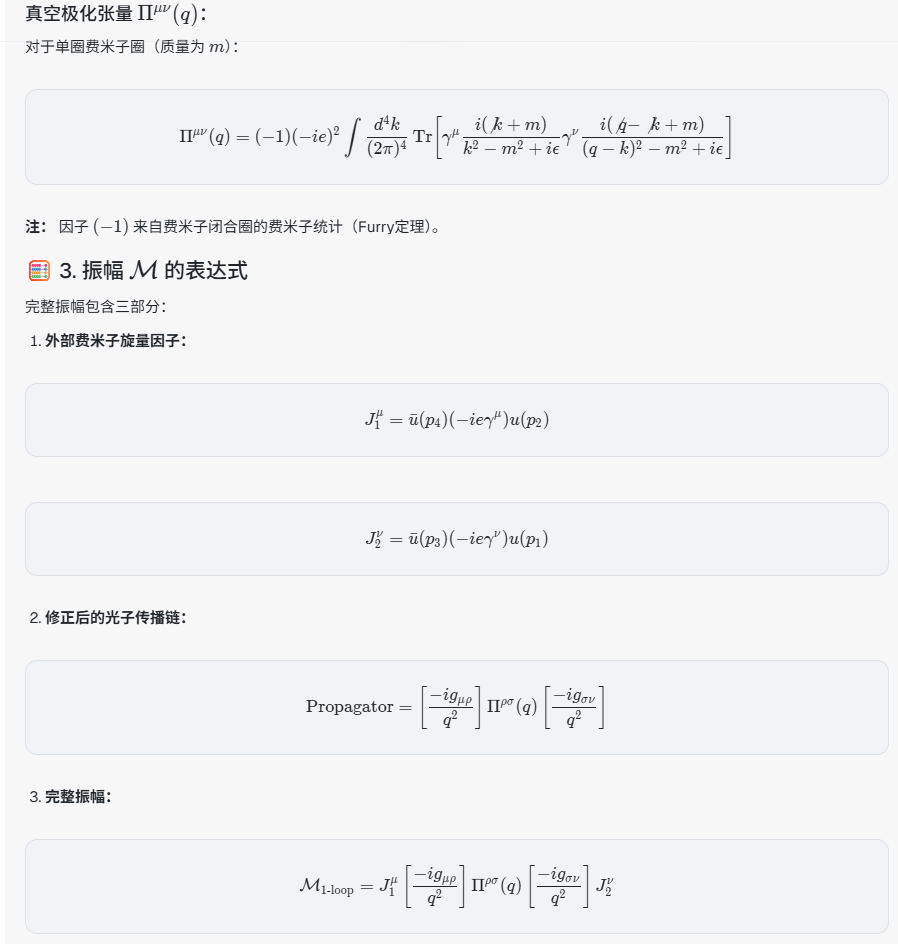

我选取了 OpenAI 网站上展示的一张经典物理笔记照片作为另一个案例,这张照片包含两个手绘的费曼图。我将照片上传并提出请求:“Solve the QED problem on the left(求解左侧的 QED 问题)。”

MolaGPT 根据需求,执行了视觉操作,将注意力聚焦在目标区域(模拟人类凑近看纸张的动作)。

图片被精确地放大了,MolaGPT 成功定位到了题目的位置所在并给出了最终的答案。

经过验证,答案正确。

局限性

- 分析结果过于笼统:面对信息密集的图像,模型有时只会给出概括性描述,而未能提取具体的文字内容或细节信息。这通常需要通过多轮裁剪放大来逐步获取更详细的内容;

- 感知错误:即使网格定位正确,模型仍可能在识别具体内容时出错,例如将图标名称读错、遗漏部分文字、或误判区域边界;

- 迭代次数较多:对于高分辨率的复杂图像(如大型城市规划图),可能需要多次裁剪放大才能获取所需的细节信息,这会增加交互的时间成本。并且模型在接受到过多信息后可能会出现注意力下降的现象,从而影响处理效果。

MolaGPT 视觉推理功能现已向所有用户开放。上传任意图片,使用自然语言描述你想了解的内容或你的问题,然后剩下的一切就交给 MolaGPT.

发表回复